HERAUSFORDERUNG

Schätzungsweise 2,5 Millionen Pädokriminelle sind jede Sekunde online.

Gleichzeitig nimmt die Zeit, die unsere Kinder am Bildschirm verbringen, immer mehr zu. Sie sind dieser Gefahr ständig ausgesetzt.

Von einer durchschnittlichen täglichen Bildschirmzeit zwischen 6 und 9 Stunden verbringen Kinder und Jugendliche mehr als 3 Stunden mit Spielen, Videochats und sozialen Medien.

Im Schatten des digitalen Fortschritts lauert eine wachsende Gefahr: Jedes fünfte Kind zwischen acht und achtzehn Jahren wurde schon mindestens einmal über digitale Kanäle angegriffen.

Innerhalb von 19 Sekunden können Unterhaltungen mit Kindern auf sozialen Spielplattformen zu hochriskanten Grooming-Situationen eskalieren.

Grooming bedeutet, dass eine Beziehung zu Kindern aufgebaut wird, um sie auf den Missbrauch vorzubereiten, indem das Vertrauen manipuliert wird und Angst und Scham eingesetzt werden, um sie zum Schweigen zu bringen.

Groomer: Hey, du scheinst cool zu sein. Welche Spiele magst du?

Kind: Hi! Ich liebe Minecraft und Fortnite.

Groomer: Nice! Die spiele ich auch. Wir sollten mal zusammen spielen. Möchtest du ein paar Tipps?

Kind: Klar, das wäre lustig!

Groomer: Super! Du kannst immer mit mir über alles reden, okay? 😊

Kind: Danke

Der ständige Zugang von Kindern zu digitalen Geräten hat dazu geführt, dass Sexting und der Austausch von nicht einvernehmlichen intimen Bildern zunehmen.

Cool, hast du ein paar Fotos von dir?

Vielleicht, warum?

Bin nur neugierig. Zeig mir eins, dann schick ich dir auch eins.

Okay, hier. 🙂

Du siehst klasse aus! Wie wär’s mit einem ohne dein Shirt?

Ich weiss nicht…

Das wird unser Geheimnis bleiben. Hier ist eins von mir

34% der befragten Mädchen und 23% der Jungen sind online mit intimen oder anzüglichen Fragen konfrontiert worden, die sie nicht beantworten wollten.

Kinder und Jugendliche werden oft dazu überredet, Nacktfotos von sich zu verschicken. Dies wird als Child Sexual Abuse Material (CSAM) bezeichnet. Als CSAM gilt jedes nackte oder sexuelle Bild oder Video von einer Person unter 18 Jahren (oder einer Person, die so dargestellt wird, als sei sie unter 18 Jahren).

gefällt es dir? schick mir auch eins

ich bin mir nicht sicher

bitte, es wird unser geheimnis sein

Okay, hier ist eins. Aber behalte es bitte für dich.

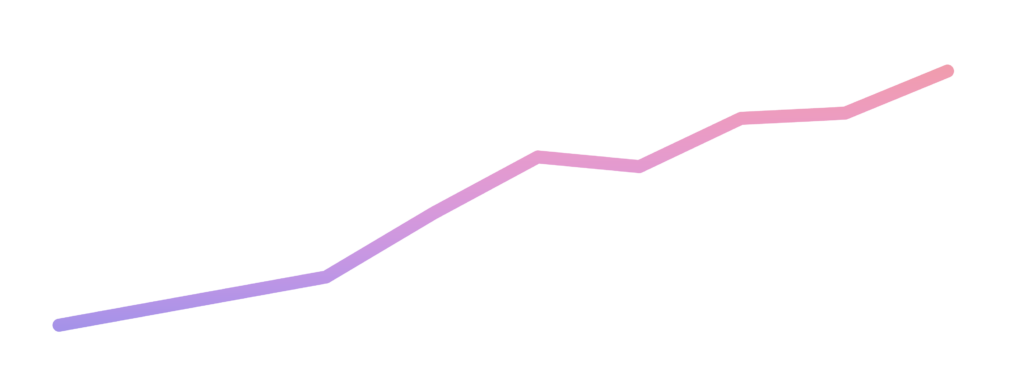

Im Jahr 2004 gab es

450,000

gemeldete Verdachtsfälle von Material über sexuellen Missbrauch von Kindern (CSAM).

Im Jahr 2023 gab es über

105 Million

gemeldete Verdachtsfälle von Material über sexuellen Missbrauch von Kindern (CSAM).

(Quellee: Thorn Foundation, 2024)

CSAM = Child Sexual Abuse Material

Doch das Vertrauen wird oft missbraucht.

Bei der Sextortion werden sexuelle Bilder verwendet, um die Opfer zu zwingen, oft mit dem Ziel eines finanziellen Gewinns. 84 % der Opfer suchten keine Hilfe, weil es ihnen zu peinlich war oder sie sich schämten. Leider erhöht Sextortion das Risiko eines Selbstmordes erheblich.

Überweise mir jetzt 500 Franken oder ich lade das Bild online hoch und zeige es allen deinen Freunden.

was? aber ich habe nicht so viel geld

schnell ich brauche es jetzt. schick mir die kreditkartendaten

Warte, warte, ich muss das Portemonnaie holen…

In jeder Schulklasse sind im Durchschnitt 1-2 betroffene Kinder

Da das Internet nie vergisst, werden die Opfer immer wieder auf Bilder und Videos angesprochen. Sie erleben daher das Trauma immer wieder.

Wir wollen dieser schrecklichen Situation ein Ende setzen.

Wir entwickeln eine Software zur Bekämpfung dieser Angriffe, die auf jedem digitalen Gerät (Computer, Smartphones und Tablets) installiert werden kann und das Kind vor schädlichen Bildern, Videos, Texten und Zugriffen schützt.

Diese KI-basierte Anwendung funktioniert ähnlich wie ein Werbeblocker auf dem Gerät. Sie verhindert jede Art von Angriff auf Text-, Audio-, Video- und Bildinhalte.